最近、Claude Codeをよく使う。ファイルを読んで、コードを書いて、エラーを修正して、また実行する。そのループを自律的に回してくれる。便利だと思う。

でも、ふと気づいた。壁打ちや書類整理は、通常のチャット型のほうが明らかに質が高い。なぜだろう、と考え始めたら、思いのほか深い話になった。

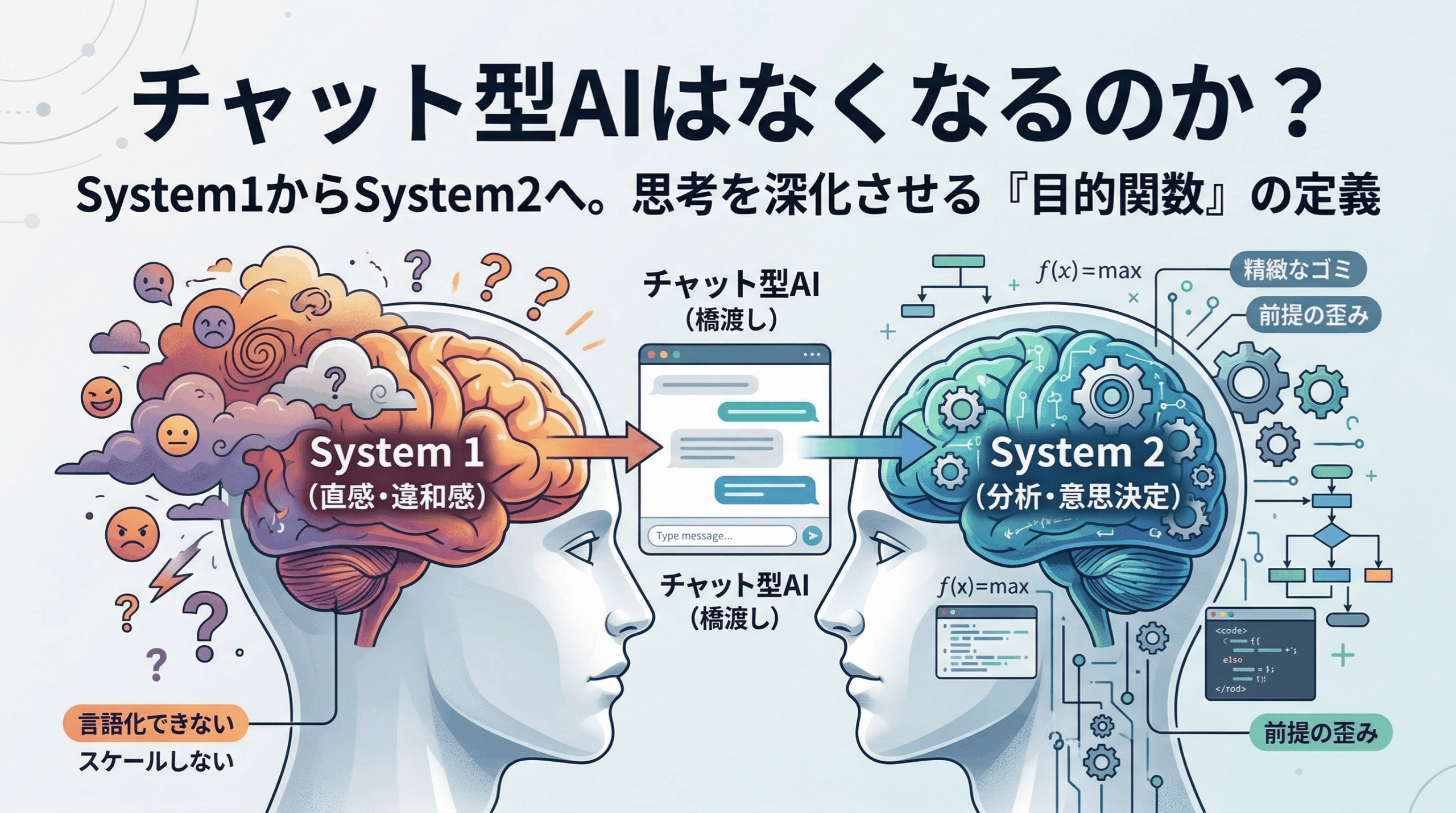

チャット型AIはなくなるのか

「AIエージェント」という言葉が騒がれている。自律的にタスクをこなすAIが主役になる時代が来る、と。

そのとき、チャット型はどうなるのか。

僕の答えは「なくならない」だ。ただし、最初にそう言ったとき、自分の中に隠れた前提があることに気づいていなかった。

その前提とは——「思考の深化はタスクに変換できない」という仮定だ。

確かに思考の操作は分解できる。「前提を疑え」「反論を当てろ」「抽象度を上げろ」。これらはアルゴリズム化できそうに見える。でも、どの操作をいつ当てるか、それ自体が思考なのだ。

エージェントは「目的関数が定義されてから」動く。

でも人間の思考は、目的関数を作るプロセスそのものが価値だったりする。

※ 目的関数とは

機械学習や最適化の文脈で「何を最大化・最小化すべきか」を定義する式のこと。AIエージェントはこの目的関数に従って行動を選択する。転じてここでは「そもそも何を達成したいのか」という目標の定義そのものを指す。エージェントは目標が明確になってから動けるが、「目標を決める」という曖昧なプロセスは苦手だ、という意味で使っている。

チャット型が残る本質的な理由は「便利だから」ではない。「人間が何を考えたいか、まだわかっていない状態」を扱えるからだと思う。

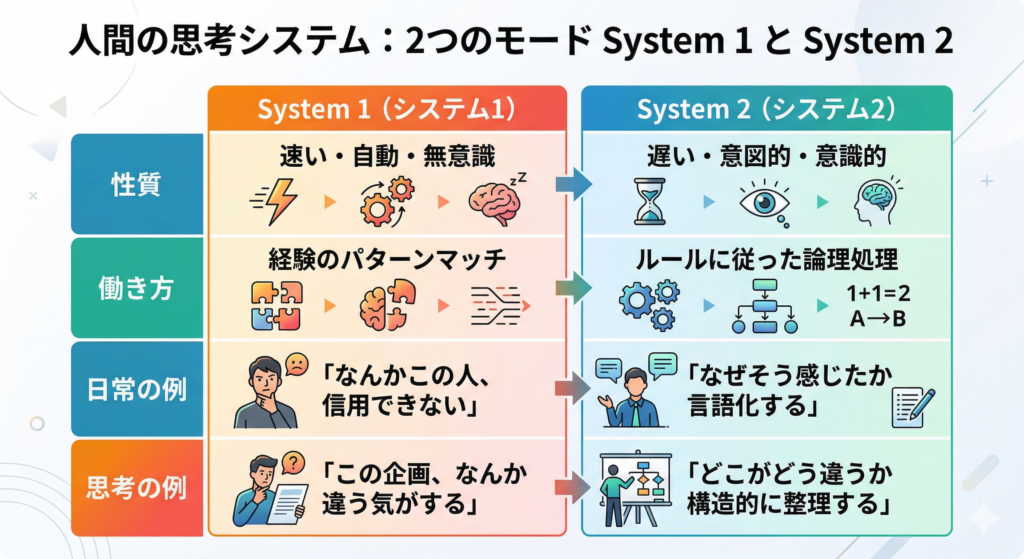

System1とSystem2という切り口

ここで認知科学者ダニエル・カーネマンの枠組みが役に立つ。彼は人間の思考を二つのシステムに分けた。

重要なのは、この二つは順番があるということだ。System1が「何かを感じ取る」ことで、System2が「それを処理する」対象が生まれる。System1なきSystem2は、処理すべき問いを自分では見つけられない。

ここがエージェントの構造的な限界につながる。

AIエージェントは本質的にSystem2の塊だ。タスクが与えられれば、驚くほど精緻に処理できる。「次に何をすべきか」を決める能力は高い。でも、「そもそも何を考えるべきかわからない状態」には構造的に弱い。なぜなら、その「わからなさ」を感知するのはSystem1の仕事だからだ。

翻って、チャット型AIが得意なのはここだ。「なんかモヤモヤする」「うまく言語化できないんだけど」——そういう曖昧なSystem1のシグナルを受け止めて、System2が扱える形に変換していく。

チャット型AIの本領:

System1(直感・違和感・モヤモヤ)

↓受け止める・引き出す

↓言語化する・構造に落とす

System2(分析・検証・意思決定)※ エージェントが得意なのは System2 以降だけ

エージェント時代が来ても、この橋渡しのプロセスは消えない。むしろエージェントが強くなるほど、「何をエージェントに任せるか」を決めるSystem1→System2の変換が、より重要になるとさえ思う。

論理派と直感派で、使い方が真逆になる

この枠組みで考えると、面白いことがわかる。論理派と直感派では、チャット型AIに求めるものが真逆になる。

論理派の問題構造

論理派はSystem2が強い。でも、System1のシグナルを無視しがちだ。結果として——

言語化できる情報だけで判断する

→ 言語化できない重要な情報を捨ててる

→ 論理的には正しいけど「なんか違う」結論が出る

もっと深刻なのは、「間違った問いを正しく解く」という罠だ。問い自体がおかしいという気づきはSystem1から来る。論理派はそこへのアクセスが細い。

さらに言えば、反論を受けても「論理で返せてしまう」。だから本当に間違っているときも修正しにくい。System2が強ければ強いほど、前提の歪みを精緻に展開してしまう。

ゴミを入れると、高品質なゴミが出てくる。

論理派の怖さはここにある。

だから論理派にとってチャット型AIの価値は、System1的な問いを投げてもらうことにある。

「それって本当に正しい問いですか?」

「見落としてる感覚的な違和感はないですか?」

——そういう揺さぶりをかけてもらう使い方が効く。

直感派の問題構造

直感派はSystem1が豊かで鋭い。でも、System2への翻訳が苦手だ。

System1は本質的に過去の経験のパターンマッチだ。経験が偏っていれば直感も偏る。しかも「なぜそう思ったか説明できない」から——

同じ判断を他人に伝えられない

→ 教えられない

→ スケールしない

確証バイアスも強化されやすい。「なんか違う気がする」という感覚で、論理的に正しい反論を感覚的に却下できてしまう。

会議で説明できない、提案書が書けない、「なんかわかるんだけど」で止まる。行動力はあるのに、組織では評価されにくいという構造になりがちだ。

だから直感派にとってチャット型AIの価値は、System2の外注先になることだ。「なんかこう思うんだよね」を投げると、言語化して、構造に落として、反証も当ててくれる。

| 論理派 | 直感派 | |

|---|---|---|

| 問題の本質 | インプットの歪みに気づかない | アウトプットを検証・伝達できない |

| 間違い方 | 精緻なゴミを作る | 正しいかもしれないが誰にも伝わらない |

| 致命傷 | 問いの設定ミス | 再現性・スケールの欠如 |

| AIの使い方 | System1的な揺さぶりをもらう | System2への翻訳を任せる |

チャット型AIが残る、本当の理由

最初の問いに戻る。チャット型AIはなくなるのか。

エージェントがどれだけ賢くなっても、「何を考えるべきかわからない状態」は人間の側に残り続ける。論理派にも直感派にも、それぞれ固有の「思考の死角」がある。

チャット型はその死角を補完する構造を持っている。これはタスク処理能力の話ではない。人間の認知構造そのものへの補完だ。

だからなくならない——と、今は言い切れる。ただし「なんとなく便利だから」ではなく、認知科学的な根拠を持って。

· · ·

余談だが、この記事の内容はチャット型AIとの対話から生まれた。僕が「構造的に問題な気がする」と感じた瞬間、それはSystem1のシグナルだった。それをSystem2に翻訳する過程が、そのままこの記事の骨格になっている。

論理派の僕が、System1を経由してSystem2で深化させる。その補助線としてチャット型AIを使った——という事実が、この記事の主張を一番よく証明しているかもしれない。

コメント